Redalyc.CÁLCULO DE LA FIABILIDAD Y CONCORDANCIA ENTRE CODIFICADORES DE UN SISTEMA DE CATEGORÍAS PARA EL ESTUDIO DEL FORO ONLIN

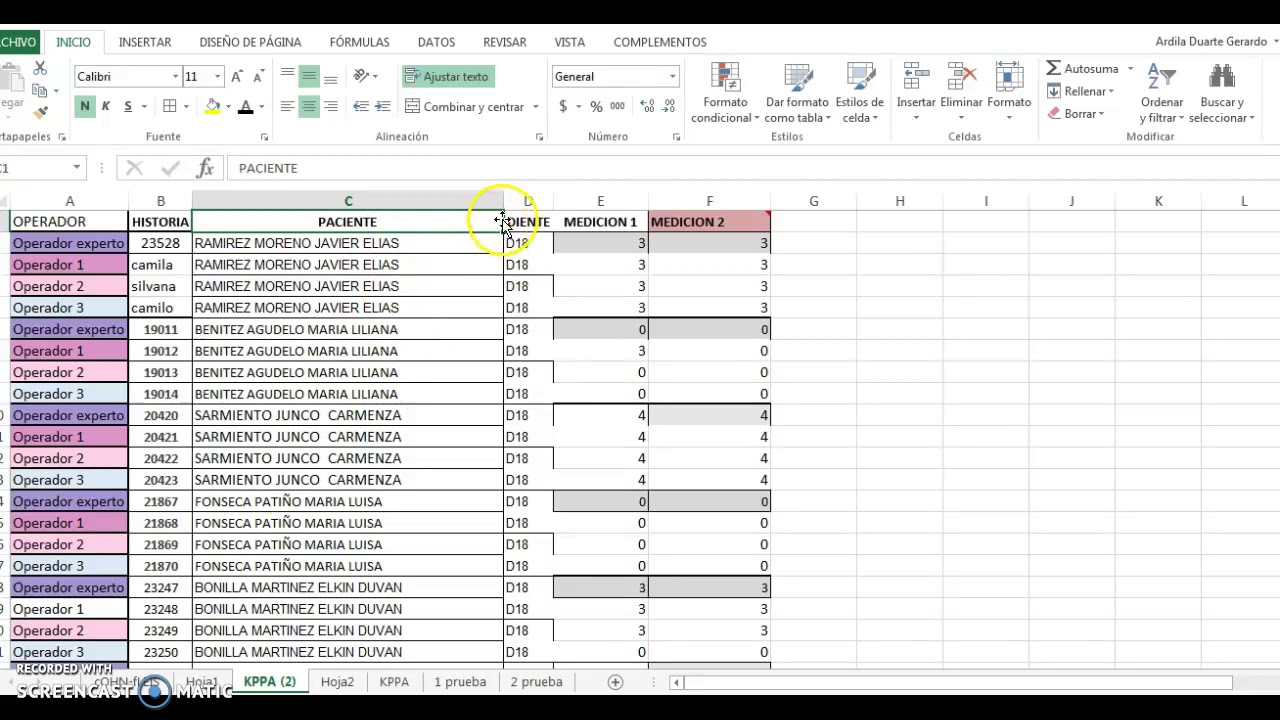

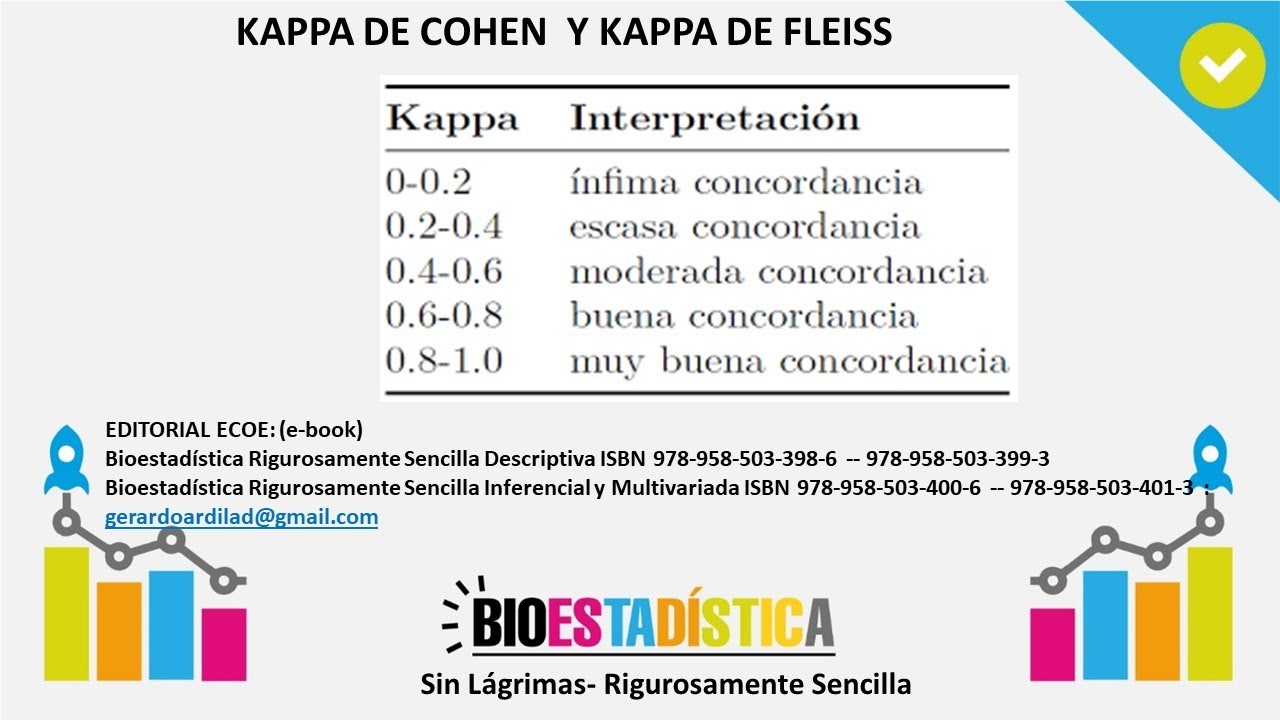

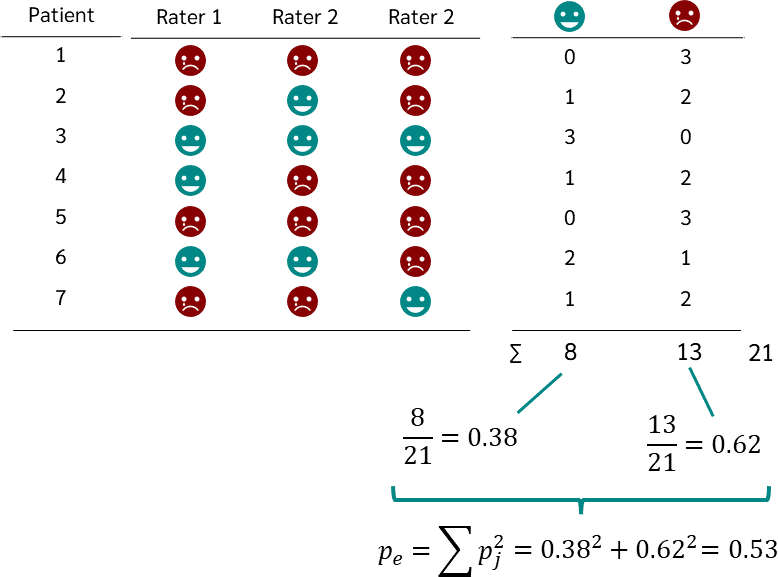

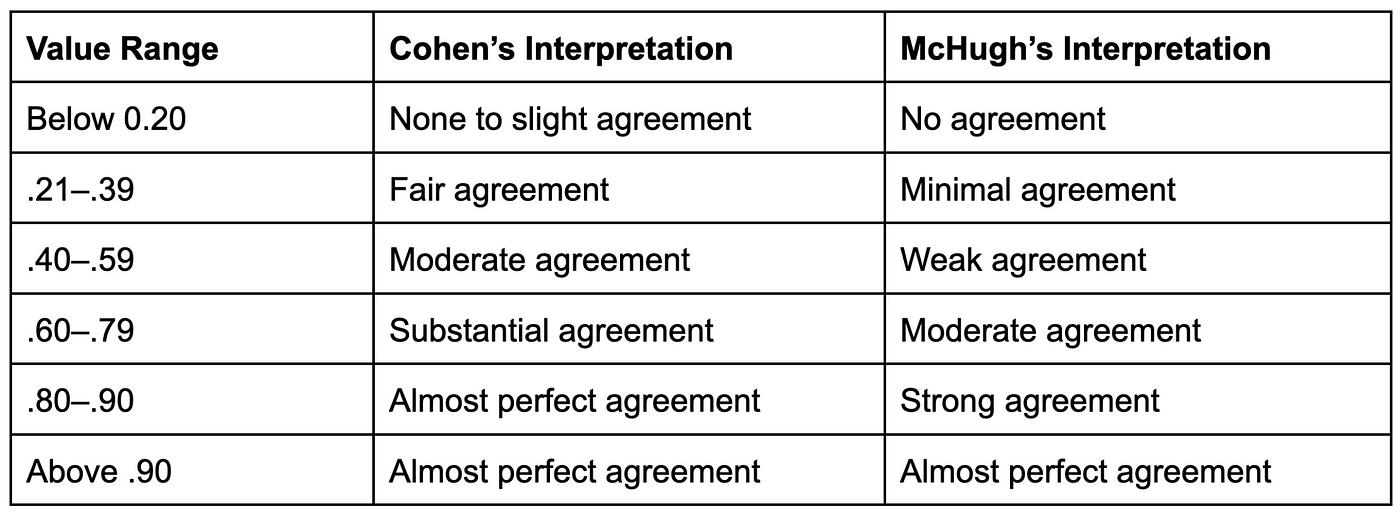

PDF) Evaluación de la concordancia inter-observador en investigación pediátrica: Coeficiente de Kappa

Redalyc.CÁLCULO DE LA FIABILIDAD Y CONCORDANCIA ENTRE CODIFICADORES DE UN SISTEMA DE CATEGORÍAS PARA EL ESTUDIO DEL FORO ONLIN

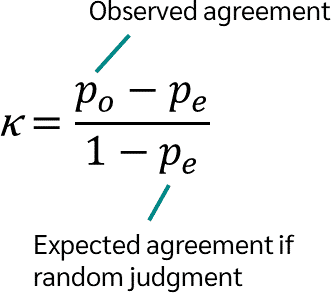

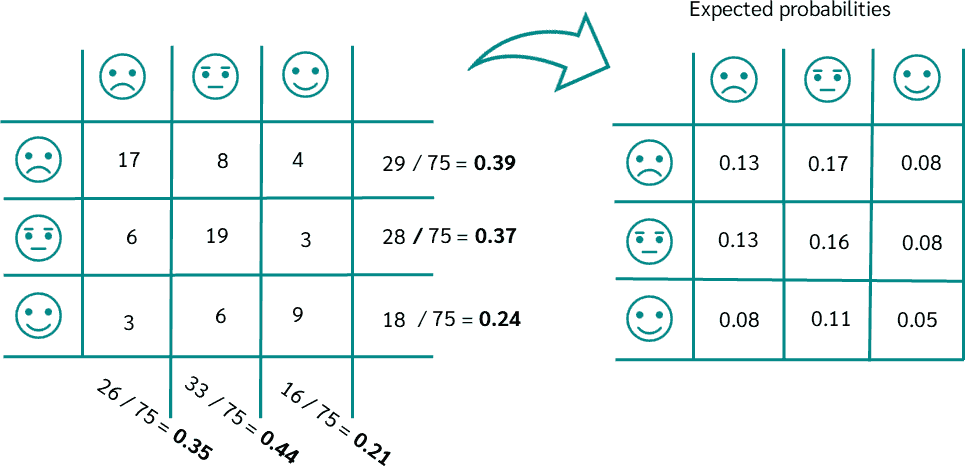

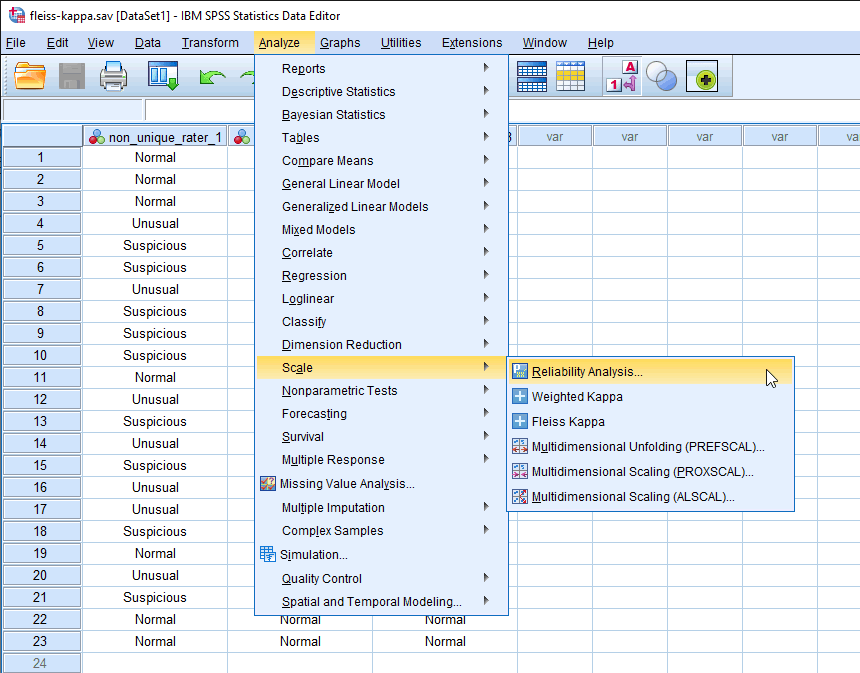

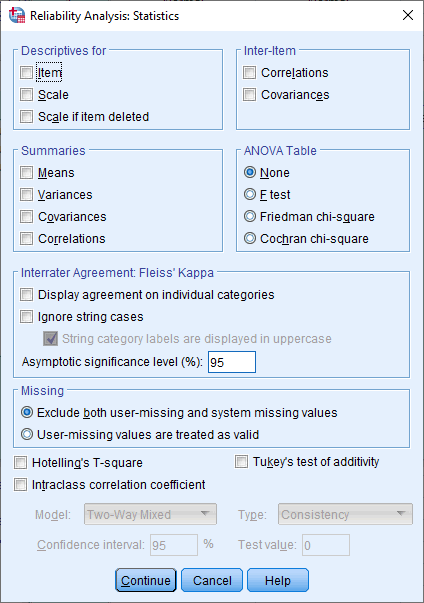

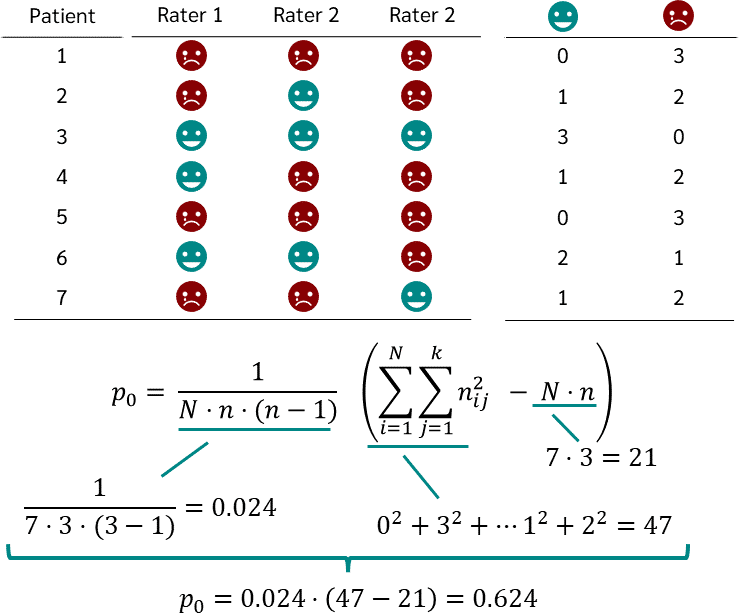

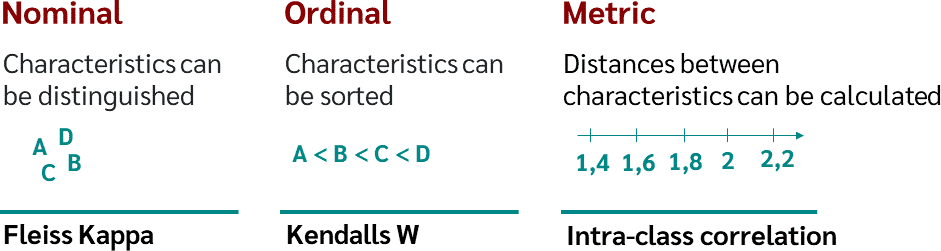

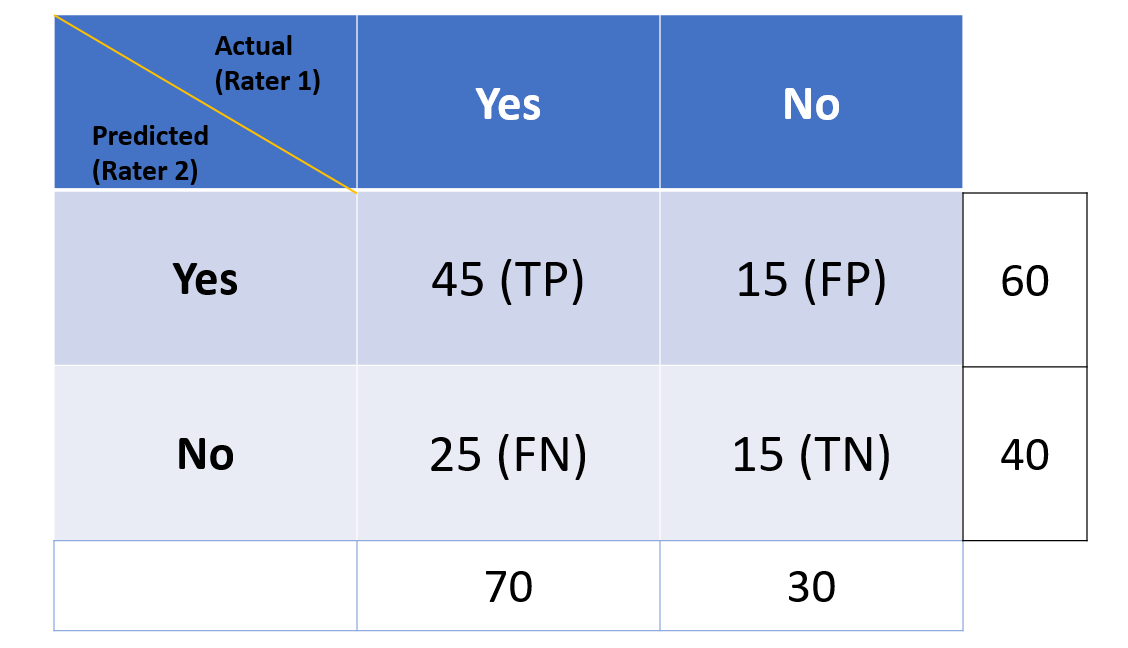

Cohen's Kappa: What it is, when to use it, and how to avoid its pitfalls | by Rosaria Silipo | Towards Data Science

Cohen's Kappa vs Fleiss Kappa - We ask and you answer! The best answer wins! - Benchmark Six Sigma Forum